Skill Factory

Categoria: Formazione e lavoro

La filiera della Formazione Professionale in Europa e in Italia

![]() Gino Visciano |

Gino Visciano |

Skill Factory - 16/02/2025 20:36:36 | in Formazione e lavoro

Skill Factory - 16/02/2025 20:36:36 | in Formazione e lavoro

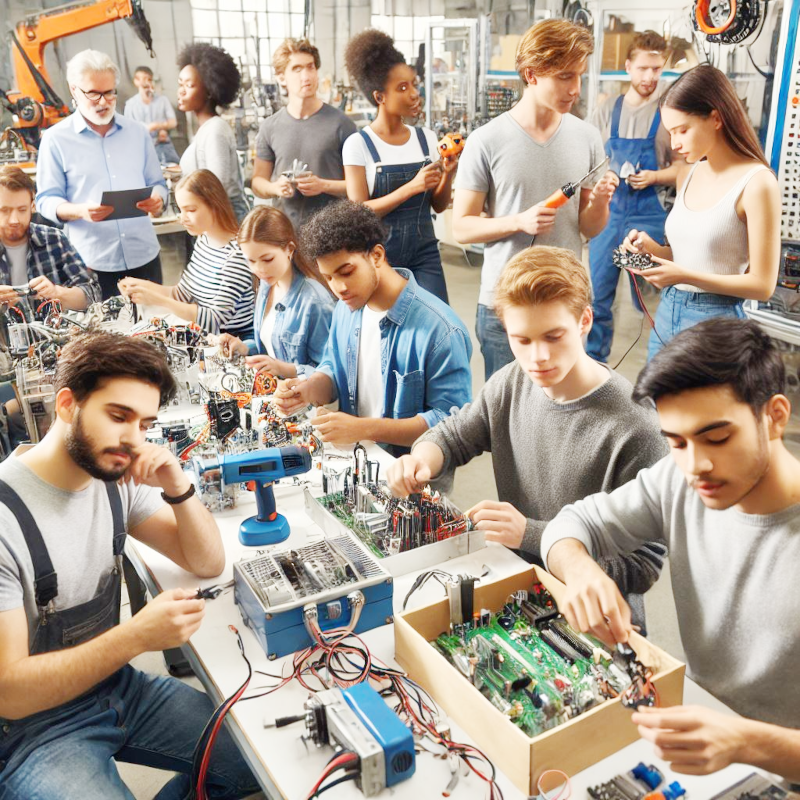

La filiera della formazione professionale, che possiamo dividere in IFP (percorsi di Istruzione e Formazione Professionale) e IFP+ (percorsi di alta Formazione Professionale), offre ai giovani l'opportunità di apprendere le competenze essenziali che favoriscono lo sviluppo personale, migliorano le prospettive professionali e incoraggiano la cittadinanza attiva. Inoltre favorisce il rendimento delle imprese, la competitività, la ricerca e l'innovazione.

La filiera della formazione professionale, che possiamo dividere in IFP (percorsi di Istruzione e Formazione Professionale) e IFP+ (percorsi di alta Formazione Professionale), offre ai giovani l'opportunità di apprendere le competenze essenziali che favoriscono lo sviluppo personale, migliorano le prospettive professionali e incoraggiano la cittadinanza attiva. Inoltre favorisce il rendimento delle imprese, la competitività, la ricerca e l'innovazione.

La filiera della formazione professionale, può anche essere divisa in IFP-I (istruzione e la formazione professionale iniziale) e IFP-P (istruzione e la formazione professionale permanente).

L'istruzione e la formazione professionale iniziale (IFP-I) viene in genere impartita a livello di istruzione secondaria superiore e post-secondaria, prima dell'ingresso nel mondo del lavoro. Si svolge in un ambiente scolastico (per lo più in aula) o in un contesto lavorativo, come centri di formazione e imprese.

In media il 50% dei giovani europei tra i 15 e i 19 anni segue un corso di istruzione e formazione professionale iniziale a livello di istruzione secondaria superiore. Tuttavia, la media dell'UE cela notevoli differenze geografiche nei tassi di partecipazione, che vanno dal 15% a oltre il 70%.

L'istruzione e la formazione professionale permanente (IFP-P) inizia dopo l'IFP-I oppure può iniziare anche dopo l'ingresso nel mondo del lavoro. Ha l'obiettivo di perfezionare le conoscenze e di aiutare i cittadini ad acquisire nuove competenze, a riqualificarsi e a proseguire lo sviluppo personale e professionale. È principalmente basata sul lavoro.

In Europa l'acronimo che fa riferimento all'istruzione e alla formazione professionale è VET (Vocation Education and Training). Dopo i percorsi d'istruzione e formazione professionale standard, esiste anche la possibilità di qualificarsi ulteriorente attraverso i percorsi di IFP+, che corrispondono ai percorsi Higher VET, come ad esempio gli IFTS o gli ITS.

IL QUADRO EUROPEO DELLE QUALIFICAZIONI (EQF)

In Europa, prima del 2008, ogni nazione utilizzava un proprio sistema di formazione e qualifica. Con l'obiettivo di favorire la mobilità dei cittadini, le pari opportunità e un adeguato livello di formazione permanente, nel 2008 è stato creato l'EQF.

In Europa, prima del 2008, ogni nazione utilizzava un proprio sistema di formazione e qualifica. Con l'obiettivo di favorire la mobilità dei cittadini, le pari opportunità e un adeguato livello di formazione permanente, nel 2008 è stato creato l'EQF.

L'EQF (European Qualifications Framework) è il quadro europeo delle qualificazioni, nasce allo scopo di comparare il livello d'istruzione e il livello di qualifica professionale degli studenti e dei lavoratori di tutta l'Europa.

Il Centro europeo per lo sviluppo della formazione professionale (Cedefop) e la Fondazione europea per la formazione (ETF), in quanto agenzie europee, svolgono un ruolo importante nel sostenere l'attuazione dell'EQF.

In Italia l'EQF è conosciuto come Quadro nazionale delle qualificazioni (QNQ), rappresenta il dispositivo nazionale che favorisce le attività per rendere comparabili i livelli di studio e le qualifiche professionali degli studenti e dei lavoratori italiani, con quelli delle altre nazioni europee.

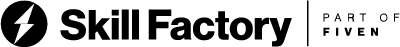

In linea con il quadro europeo delle qualifiche (EQF) , il QNQ si sviluppa su tre dimensioni:

1) conoscenze

2) abilita'

3) autonomia e responsabilita'.

Attraverso queste tre dimensioni si può descrivere il tipo di competenza che bisogna avere per raggiungere uno degli 8 livelli di qualificazione EQF, dove il livello 1 è il più basso e l'8 è il più alto.

Per i giovani che seguono i percorsi di formazione professionale o di alta formazione professionale è importante capire alla fine di ogno percorso seguito qual è il livello di EQF che si ottiene.

IL SETTORE ECONOMICO PROFESSIONALE

Il Settore Economico Professionale (SEP), nel contesto dell'European Qualifications Framework (EQF), rappresenta il repertorio delle qualifiche professionali organizzato per aree economiche e professionali.

Il SEP è utile perché:

1. Permette ai lavoratori e agli studenti di capire quali competenze sono richieste in un determinato settore economico e professionale e qual è livello EQF corrispondente.

2. Serve per la creazione di percorsi formativi mirati

3. Facilita il riconoscimento delle qualifiche in altri paesi europei.

Per accedere al "Repertorio dei Titoli e delle Qualifiche" della regione Campania clicca qui.

L'ATTLANTE DEL LAVORO E DELLE QUALIFICAZIONI

Per avere una mappa dettagliata del lavoro e delle qualificazioni, del nostro Sistema nazionale di certificazione delle competenze, è possibile consultare l'ATLANTE DEL LAVORO E DELLE QUALIFICAZIONI.

L'Atlante nasce dal lavoro di ricerca condotto dall'INAPP (Istituto Nazionale Per l'Analisi delle Politiche Pubbliche), con la partecipazione di diversi soggetti istituzionali, delle parti datoriali e sindacali, delle rappresentanze bilaterali, delle associazioni professionali, degli esperti settoriali e degli stakeholder del sistema lavoro-learning.

Per accedere all'ATLANTE DEL LAVORO E DELLE QUALIFICAZIONI, clicca qui.

In Italia la filiera della formazione professionale è organizzata in:

1. IeFP

2. IFTS

3. PAR GOL

4. ITS.

Per IeFP s'intende "Istruzione e Formazione Professionale", si tratta di istruzione e formazione su competenze specifiche di tipo professionale e tecnico.

Per i giovani gli IeFP sono un'opportunità, perché preparano al mondo del lavoro e ne sviluppano le competenze affinché possano mantenere le loro possibilità di collocamento e rispondere ai cambiamenti del mercato.

Tra i settori in cui l’IeFP è particolarmente diffuso figurano quello alberghiero e della ristorazione, della distribuzione, dell’ingegneria, della contabilità e del lavoro d’ufficio. Anche gli apprendistati e i tirocini svolti all’interno di imprese o organizzazioni possono essere classificati come IeFP, giacché forniscono alle persone le competenze necessarie per eccellere in un settore specifico.

Le scuole o enti professionali di tipo IeFP prevedono i percorsi seguenti:

- percorsi triennali finalizzati al conseguimento della Qualifica professionale di Operatore;

- percorsi quadriennali, senza uscita al terzo anno, finalizzati al conseguimento del Diploma professionale di Tecnico;

- percorsi di quarto anno successivi al conseguimento di una qualifica professionale, finalizzati al conseguimento del Diploma professionale di Tecnico.

Il sistema regionale di Istruzione e Formazione Professionale (IeFP) è uno dei canali per l'assolvimento dell'obbligo di istruzione e del diritto-dovere all'istruzione e alla formazione stabiliti dalla legge.

Con la complessiva riforma della scuola superiore il sistema di IeFP regionale è stato pienamente riconosciuto nell'ambito del secondo ciclo di istruzione ed i titoli rilasciati sono validi - al pari di quelli scolastici - su tutto il territorio nazionale, poiché fanno riferimento a repertori di figure professionali e a standard di competenze concordati a livello nazionale tra tutte le Regioni e lo Stato.

L'offerta di percorsi di IeFP è assicurata sul territorio regionale dalle istituzioni formative accreditate e dalle istituzioni scolastiche superiori statali e paritarie, nonché dalle imprese nel caso dei percorsi formativi rivolti ai loro apprendisti.

L'offerta di percorsi di IeFP è assicurata sul territorio regionale dalle istituzioni formative accreditate e dalle istituzioni scolastiche superiori statali e paritarie, nonché dalle imprese nel caso dei percorsi formativi rivolti ai loro apprendisti.

Dal punto di vista didattico-organizzativo consentono ampi spazi di flessibilità e di personalizzazione offrendo, in tal modo, agli allievi la possibilità di raggiungere le competenze attese secondo le capacità, i livelli di maturazione e gli stili di apprendimento individuali.

Pur assicurando una adeguata formazione culturale di base, possiedono un carattere meno teorico dei percorsi scolastici, in quanto privilegiano l'apprendimento in contesti pratici (laboratorio); inoltre, a partire dal 2° anno (e comunque dopo il 15° anno di età) sono previsti periodi di stage obbligatori presso le imprese.

Non esistono quadri orari generali delle discipline ma devono essere comunque garantite percentuali minime e massime di monte ore dedicato sia all'area delle competenze di base sia all'area delle competenze tecnico-professionali; hanno una durata annuale minima di 990 ore.

Gli IeFP consentono già al termine del 3° anno il diretto inserimento professionale e la spendibilità, nel mondo del lavoro, delle certificazioni e dei titoli acquisiti.

I percorsi di qualifica della IeFP hanno la durata di 3 anni a conclusione dei quali gli studenti sostengono un esame finalizzato ad acquisire l'attestato di qualifica professionale di terzo livello EQF.

Tale titolo consente di accedere ad un quarto anno (non obbligatorio) che offre la possibilità di migliorare la preparazione professionale e di conseguire il "diploma professionale" di quarto livello EQF.

E' inoltre possibile rientrare nel sistema scolastico (in particolare nel sistema dell'Istruzione Professionale) per ottenere un diploma di scuola secondaria superiore, previa verifica da parte dell'istituzione scolastica del livello di preparazione dell'allievo ai fini del suo inserimento nella classe adeguata.

La stessa opportunità è riconosciuta agli studenti del sistema di istruzione che intendano passare al sistema di IeFP.

I percorsi di IeFP prevedono risultati di apprendimento sia di carattere generale (competenze culturali di base, comuni a tutti i percorsi di qualifica/diploma professionale) sia di carattere professionale (competenze tecnico-professionali specifiche previste per ciascun percorso di qualifica e di diploma professionale) ed hanno le seguenti caratteristiche:

1. sono declinati in termini di competenza, intesa come comprovata capacità di utilizzare, in situazioni di lavoro, di studio o nello sviluppo professionale e personale, un insieme strutturato di conoscenze e di abilità acquisite nei contesti di apprendimento formale, di apprendimento non formale o di apprendimento informale;

2. sono descritti e definiti secondo i criteri e le regole previsti da standard nazionali; recepiscono ed assicurano i saperi e le competenze sia degli assi culturali previsti per l'assolvimento dell'obbligo di istruzione (che garantiscono l'equivalenza formativa dei primi due anni di tutti i percorsi del secondo ciclo), sia degli standard nazionali.

I risultati di apprendimento attesi alla conclusione del percorso triennale riguardano, in generale, il raggiungimento di un livello di alfabetizzazione culturale necessario per inserirsi in modo consapevole nella vita sociale e lavorativa e di un grado di autonomia professionale sostanzialmente di tipo esecutivo che permette di realizzare le attività in modo corrispondente alle indicazioni ricevute e con le modalità più adeguate.

Gli esiti di apprendimento attesi al termine del quarto anno si caratterizzano, invece, per lo sviluppo di una maggiore riflessività e capacità di affrontare problematiche più ampie e per un maggiore approfondimento delle conoscenze professionali (per esempio: della microlingua tecnica o delle metodologie scientifiche specifiche di settore) che permettono di raggiungere un grado di autonomia più elevato nell'attività lavorativa e forme più avanzate di partecipazione sociale e civile, anche nell'ambito della comunità professionale di riferimento.

Sia le competenze di base sia quelle tecnico-professionali favoriscono, inoltre, lo sviluppo di risorse personali, sociali, di apprendimento e di imprenditorialità che concorrono al raggiungimento dei risultati di apprendimento e riguardano:

1. la capacità di lavorare con gli altri in maniera costruttiva, che presuppone la conoscenza dei codici di comportamento e delle norme di comunicazione generalmente accettati in ambienti e società diversi, nonché abilità quali, ad esempio: lavorare in gruppo, interagire e collaborare con gli altri, gestire i conflitti, negoziare, esprimere e comprendere punti di vista diversi, superare pregiudizi, accettare critiche costruttive, dimostrare empatia, assistere e aiutare i colleghi, essere tolleranti, gestire l'incertezza e lo stress, creare fiducia;

2. la capacità di gestire il proprio apprendimento e sviluppo professionale, che comporta la conoscenza dei diversi modi di sviluppare le competenze e delle diverse tipologie e metodi di apprendimento, nonché abilità quali, ad esempio: individuare le proprie capacità, essere consapevoli della necessità di sviluppo delle proprie competenze, organizzare il proprio apprendimento, riflettere criticamente e su se stessi, dimostrare curiosità e volontà di apprendere, cercare opportunità di apprendimento, formazione e carriera, gestire efficacemente il tempo e le informazioni, gestire la complessità e l'incertezza, sapersi concentrare, prendere decisioni, perseverare, valutare, individuare forme di orientamento e sostegno;

3. la capacità di agire in modo imprenditoriale ed innovativo, che comporta la conoscenza di principi etici e delle opportunità e difficoltà sociali ed economiche, nonchè abilità quali, ad esempio: pensare in modo strategico e creativo, riflettere in modo critico, risolvere problemi, prendere decisioni, accettare le responsabilità, essere consapevoli dei propri punti di forza e delle proprie debolezze, gestire l'incertezza e il rischio, esprimere spirito di iniziativa, perseverare nel raggiungimento degli obiettivi, motivare gli altri e valorizzare le loro idee;

4. la capacità di sviluppare e mantenere il proprio benessere fisico ed emotivo, che presuppone la conoscenza degli elementi che compongono mente, corpo e stili di vita salutari, nonchè abilità quali, ad esempio: porre attenzione al proprio benesse fisico ed emotivo, prevenire comportamenti a rischio, riconoscere e gestire cause ed effetti dello stress, gestire le incertezze, riflettere criticamente e su se stessi, gestire relazioni affettive nel rispetto di sé e degli altri.

Di seguito sono descritti i risultati di apprendimento relativi alle competenze culturali di base comuni ai percorsi triennali di qualifica professionale e ai percorsi di 4° anno di diploma professionale.

Competenze culturali di base dei percorsi triennali

Le competenze culturali di base comuni a tutti i percorsi di qualifica professionale di IeFP sono individuate in relazione agli ambiti delle competenze chiave per l'apprendimento permanente definite dall'Unione Europea e riguardano:

- competenze alfabetiche funzionali - comunicazione

- competenza linguistica

- competenze matematiche, scientifiche e tecnologiche

- competenze storico-geografico-giuridiche ed economiche

- competenza digitale

- competenza di cittadinanza.

Competenze culturali di base dei percorsi del quarto anno

Le competenze culturali di base comuni a tutti i percorsi di diploma professionale di IeFP sono individuate in relazione agli ambiti delle competenze chiave per l'apprendimento permanente definite dall'Unione Europea e riguardano:

- competenze alfabetiche funzionali - comunicazione

- competenza linguistica

- competenze matematiche, scientifiche e tecnologiche

- competenze storico-geografico-giuridiche ed economiche

- competenza digitale

- competenza di cittadinanza.

Può accedere ai corsi IFTS chi possiede il Diploma di Istruzione Secondaria Superiore o il Diploma Professionale di tecnico conseguito nei percorsi di IeFP. Obiettivo finale del percorso è quello di formare figure professionali tecniche di livello medio-alto, oggi molto richieste dalle aziende che si mostrano attente alle innovazioni e sempre al passo con le nuove tecnologie.

Può accedere ai corsi IFTS chi possiede il Diploma di Istruzione Secondaria Superiore o il Diploma Professionale di tecnico conseguito nei percorsi di IeFP. Obiettivo finale del percorso è quello di formare figure professionali tecniche di livello medio-alto, oggi molto richieste dalle aziende che si mostrano attente alle innovazioni e sempre al passo con le nuove tecnologie.

Gli ulteriori requisiti, richiesti per partecipare ai percorsi IFTS, sono stabiliti dal bandi regionali di riferimento, approvato annualmente. I corsi IFTS hanno una durata che varia da 800 a 1000 ore. Sono suddivisi in 2 semestri e prevedono attività teoriche, pratiche e di laboratorio. In particolare, il tempo dedicato all’attività di tirocinio formativo e stage aziendale non può essere inferiore al 40% del monte ore complessivo del corso. I docenti che ti accompagnano questi percorsi sono esperti che provengono direttamente dal mondo del lavoro, con esperienza concreta nel settore professionale di riferimento.

I corsi IFTS rilasciano un Certificato di Specializzazione Tecnica Superiore (IV livello EQF) relativo all’indirizzo di studi scelto dal candidato.

Esistono diversi indirizzi, i quali possono cambiare da una regione all’altra. Ecco i principali:

- Manifattura e artigianato: per la realizzazione artigianale di prodotti Made in Italy

- Meccanica: per l’installazione e manutenzione di impianti, la progettazione industriale e la programmazione della produzione

- Edilizia: tecniche innovative per l’organizzazione e gestione dei cantieri

- Servizi commerciali: amministrazione economico-finanziaria

- Turismo e sport: promozione di prodotti e servizi turistici

- Cultura, informazione e tecnologie informatiche: progettazione e sviluppo di tecnologie informatiche, produzione multimediale e gestione database

Per conoscere i percorsi IFTS nella tua regione consulta il catalogo di riferimento.

Possono accedere ai corsi PAR GOL:

Possono accedere ai corsi PAR GOL:- Beneficiari di sostegno al reddito;

- Persone che ricevono sostegno finanziario;

- Lavoratori fragili o vulnerabili;

- Lavoratori maturi (55 anni e oltre);

- Persone con esperienza lavorativa avanzata.

- Donne che si trovano in situazioni difficili.

- Persone con disabilità.

Il programma PAR GOL offre la possibilità di accedere a diversi corsi di formazione gratuiti, specificamente progettati per potenziare le competenze dei lavoratori, agevolarne la riqualificazione e favorire lo sviluppo del potenziale per l’inserimento o il reinserimento nel mercato del lavoro.

Questi corsi coprono una vasta gamma di settori e competenze, consentendo ai partecipanti di acquisire la abilità richieste dalle aziende. Oltre alla formazione gratuita, è prevista anche una indennità di partecipazione e il rilascio di una qualifica professionale europea (EQF), il livello della qualifica dipende dal corso professionale scelto.

Gli ITS sono scuole di eccellenza ad alta specializzazione tecnologica post diploma che permettono di conseguire il titolo di tecnico superiore. Sono espressione di una strategia fondata sulla connessione delle politiche d'istruzione, formazione e lavoro con le politiche industriali.

le aree tecnologiche e le figure professionali di riferimento degli ITS Academy per la realizzazione dei percorsi formativi sono le seguenti:

- Efficienza energetica;

- Mobilità sostenibile;

- Nuove tecnologie della vita;

- Nuove tecnologie per il Made in Italy (articolata in cinque ambiti: Sistema agroalimentare, Sistema casa, Sistema meccanica, Sistema moda, Servizi alle imprese);

- Tecnologie innovative per i beni e le attività culturali/Turismo;

- Tecnologie della informazione e della comunicazione.

Possono accedere ai corsi, i giovani e gli adulti anche occupati in possesso di diploma di istruzione secondaria superiore e coloro che sono in possesso di un diploma quadriennale di istruzione e formazione professionale unitamente ad un certificato di specializzazione tecnica superiore conseguito all’esito di un corso IFTS della durata di almeno 800 ore.

I corsi sono biennali o triennali e sono articolati in semestri:

i corsi biennali di V livello EQF (quinto livello del Quadro europeo delle qualifiche per l’apprendimento permanente) hanno la durata di quattro semestri con almeno 1.800 ore di formazione. Al termine del corso e previo superamento delle prove e valutazioni finali viene conseguito il “diploma di specializzazione per le tecnologie applicate”;

i corsi triennali di VI livello EQF (sesto livello del Quadro europeo delle qualifiche per l’apprendimento permanente) hanno la durata di sei semestri con almeno 3.000 ore di formazione. Al termine del corso e previo superamento delle prove e valutazioni finali viene conseguito il “diploma di specializzazione superiore per le tecnologie applicate”.

i corsi triennali di VI livello EQF (sesto livello del Quadro europeo delle qualifiche per l’apprendimento permanente) hanno la durata di sei semestri con almeno 3.000 ore di formazione. Al termine del corso e previo superamento delle prove e valutazioni finali viene conseguito il “diploma di specializzazione superiore per le tecnologie applicate”.

Entrambi i diplomi sono rilasciati dal Ministero dell’istruzione e del merito insieme all’“Europass diploma supplement”, hanno validità su tutto il territorio nazionale e costituiscono titolo valido per l’accesso ai pubblici concorsi.

Ogni semestre comprende ore di attività teorica, pratica e di laboratorio. L’attività formativa è svolta per almeno il 60 per cento del monte orario complessivo da docenti provenienti dal mondo del lavoro. Gli stage aziendali e i tirocini formativi sono obbligatori almeno per il 35 per cento della durata del monte orario complessivo e possono essere svolti anche all’estero.

Al termine del corso, gli allievi che vi sono ammessi sostengono le prove di verifica finale delle competenze acquisite.

Le prove sono tre e sono correlate all’area tecnologica, ambito e figura professionale di riferimento del percorso formativo:

1. una prova scritta;

2. una prova teorico pratica;

3. una prova orale .

La prova scritta consiste in un set di trenta domande a risposta chiusa a scelta multipla, di cui cinque volte a valutare le competenze di lingua straniera.

La prova teorico pratica concerne la trattazione di un problema tecnico scientifico e due quesiti a risposta sintetica.

La prova orale concerne la discussione di un progetto di lavoro – project work – sviluppato durante il tirocinio formativo e lo stage aziendale svolti all’interno dell’impresa.

Per il superamento delle prove di verifica finale è necessario conseguire almeno il punteggio minimo in ciascuna di esse.

La valutazione delle prove è effettuata dalla Commissione esaminatrice, composta da:

- un docente universitario o docente degli Istituti di Alta formazione artistica musicale e coreutica o ricercatore, con funzione di Presidente, designato dal Ministero dell’istruzione e del merito;

- un esperto di formazione professionale designato dalla Regione;

- un docente di discipline tecnico professionali di Istituto di scuola secondaria di secondo grado;

- due esperti del mondo del lavoro designati dal Comitato tecnico scientifico dell’ITS Academy, uno dei quali abbia svolto funzioni di tutoraggio nel corso di formazione e l’altro individuato nell’ambito dell’area professionale o imprenditoriale di riferimento della Fondazione.

Su richiesta degli allievi la Fondazione rilascia la certificazione delle competenze acquisite all’interno dei percorsi, comprese quelle acquisite nelle attività di tirocinio formativo e di stage aziendale, anche in caso di mancato completamento del percorso formativo o di mancato superamento delle prove di verifica finale.

CHE COSA FA LA UE NEL SETTORE DELL'IFP

La cooperazione europea in materia di istruzione e formazione professionale risale al 2002 e al processo di Copenaghen. È stata ulteriormente rafforzata nel corso degli anni, ad esempio dal comunicato di Bruges e dalle conclusioni di Riga. L'istruzione e la formazione professionale sono state individuate come un settore prioritario per la cooperazione nell'ambito dell'iniziativa per lo spazio europeo dell'istruzione nel periodo 2021-2030.

La cooperazione europea in materia di istruzione e formazione professionale risale al 2002 e al processo di Copenaghen. È stata ulteriormente rafforzata nel corso degli anni, ad esempio dal comunicato di Bruges e dalle conclusioni di Riga. L'istruzione e la formazione professionale sono state individuate come un settore prioritario per la cooperazione nell'ambito dell'iniziativa per lo spazio europeo dell'istruzione nel periodo 2021-2030.

Il 24 novembre 2020 il Consiglio dell'UE ha adottato una raccomandazione relativa all'istruzione e formazione professionale (IFP) per la competitività sostenibile, l'equità sociale e la resilienza. La raccomandazione definisce i principi fondamentali per garantire che l'istruzione e la formazione professionale siano flessibili, in quanto capaci di adattarsi rapidamente alle esigenze del mercato del lavoro e di offrire opportunità di apprendimento di qualità sia ai giovani che agli adulti.

Nel panorama europeo gli studenti iscritti a percorsi di Istruzione e Formazione Professionale (IFP) sono complessivamente circa il 48% di che accedono alla Scuola secondaria di secondo grado.

LA CARTA DEI DIRITTI FONDAMENTALI DELL'UE

la Carta dei diritti fondamentali dell’Unione europea è un documento che riconosce l’istruzione e l’accesso alla formazione professionale e continua come un diritto fondamentale e sottolinea come gli obiettivi di sviluppo sostenibile delle Nazioni Unite prevedono entro il 2030 pari accesso per tutte le donne e tutti gli uomini a un’istruzione tecnica, professionale e terziaria, anche universitaria, che sia di qualità così da aumentare in modo consistente il numero dei giovani e degli adulti in possesso delle competenze tecniche e professionali necessarie a garantirne un adeguato inserimento lavorativo e a favorirne la capacità imprenditoriale.

la Carta dei diritti fondamentali dell’Unione europea è un documento che riconosce l’istruzione e l’accesso alla formazione professionale e continua come un diritto fondamentale e sottolinea come gli obiettivi di sviluppo sostenibile delle Nazioni Unite prevedono entro il 2030 pari accesso per tutte le donne e tutti gli uomini a un’istruzione tecnica, professionale e terziaria, anche universitaria, che sia di qualità così da aumentare in modo consistente il numero dei giovani e degli adulti in possesso delle competenze tecniche e professionali necessarie a garantirne un adeguato inserimento lavorativo e a favorirne la capacità imprenditoriale.

I sistemi di istruzione e formazione professionale innovativi e di elevata qualità devono fornire alle persone – giovani ma anche adulte – competenze per il lavoro, lo sviluppo personale e la cittadinanza. Mettendoli in condizione di costruirsi un patrimonio personale di abilità, conoscenze e competenze ampio e articolato, che permette loro di adattarsi alle transizioni in atto nel contesto sociale e al mutare delle richieste nel mercato del lavoro. Ne è un esempio la duplice transizione digitale e verde in atto, con le ripercussioni sulla crescita economica e sullo sviluppo sociale che genera.

Ogni Paese membro dell’UE a livello nazionale deve impegnarsi a sviluppare l’IFP, introducendo una maggiore flessibilità e rafforzando le opportunità di apprendimento basate sul lavoro e sul miglioramento della qualità dei percorsi di studio.

Le indicazioni seguenti sono importanti per garantire la qualità degli IFP:

1. Essere agili nell’adattarsi ai cambiamenti del mercato del lavoro;

2. Mettere al centro la flessibilità e le opportunità di avanzamento. Questo aiuta a raggiungere un forte impegno e a rendere i percorsi IFP più interessanti, il che porta a una maggiore occupabilità;

3. Essere un motore di innovazione e crescita. La formazione IFP dovrebbe essere adattata e ampliata per promuovere l’apprendimento di competenze imprenditoriali, digitali e verdi;

4. Rappresentare una scelta attraente, basata su competenze moderne e digitalizzate e sull’offerta di formazione;

5. Promuovere le pari opportunità. I programmi IFP dovrebbero essere inclusivi e accessibili per gruppi vulnerabili;

6. Offrire modelli di formazione flessibili per contribuire a prevenire l’abbandono precoce degli studenti;

7. Essere sostenuti da una cultura di garanzia della qualità.

DICHIARAZIONE DI OSNABRÜCK RELATIVA ALL’ISTRUZIONE E ALLA FORMAZIONE PROFESSIONALE

Il 30 novembre 2020 i ministri incaricati dell’istruzione e della formazione professionale degli Stati membri, dei paesi candidati all’adesione all’Unione europea (UE), dei paesi dello Spazio economico europeo (SEE), e delle parti sociali europee e della Commissione europea, si sono riuniti a Osnabrück per concordare una nuova serie di azioni politiche in materia di istruzione e formazione professionale per il periodo 2021-2025 volte a integrare e concretizzare gli obiettivi strategici e la visione definiti nella raccomandazione del Consiglio relativa all’istruzione e formazione professionale per la competitività sostenibile, l’equità sociale e la resilienza. L’attuazione di tutti gli obiettivi e di tutte le azioni avverrà nella debita osservanza del principio di sussidiarietà e in conformità ai contesti nazionali di IFP.

La Dichiarazione di Osnabrück 2020 mira a rafforzare l’istruzione e formazione professionale in Europa per renderla più resiliente, innovativa e inclusiva, in linea con le sfide della digitalizzazione, della transizione verde e si fonda su quattro obiettivi principali:

Obiettivo 1: resilienza ed eccellenza tramite un’IFP di qualità, inclusiva e flessibile;

Obiettivo 2: istituzione di una nuova cultura dell’apprendimento permanente — Importanza di un’IFP continua e della digitalizzazione;

Obiettivo 3: sostenibilità, un filo verde nell’IFP;

Obiettivo 4: settore europeo dell’istruzione e della formazione e dimensione internazionale dell’IFP.

Clicca qui per scaricare il documento la dichiarazione di Osnabrück 2020.

Riferimenti

https://education.ec.europa.eu/

https://education.ec.europa.eu/it/education-levels/vocational-education-and-training/about-vocational-education-and-training

https://invalsiopen.it/ifp-uno-sguardo-verso-il-futuro/

https://www.dopolaterzamedia.provincia.cremona.it/it-it/istruzione-e-formazione-professionale-iefp/guida/53

https://www.regione.lombardia.it/wps/portal/istituzionale/HP/formazioneprofessionale/ifts-cosa-sono

https://lavoro.regione.campania.it/index.php/220-ifts/319-ifts-percorsi-di-istruzione-e-formazione-tecnica-superiore

https://www.mim.gov.it/tematica-its

https://www.skillbook.it/Blog/Details/2238

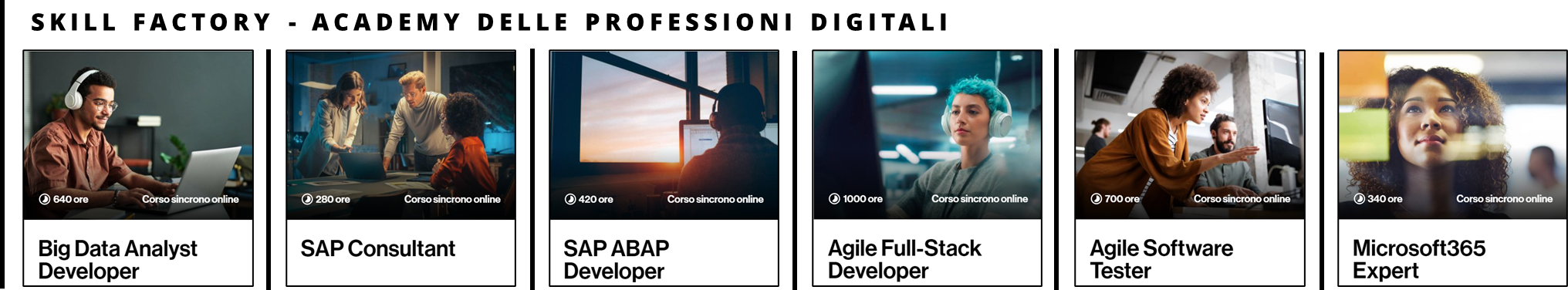

Vuoi qualificarti per entrare nel modo del lavoro?

Presso la nostra Academy delle Professioni Digitali, con il programma PAR GOL puoi partecipare ai seguenti corsi di formazione gratuiti di 300 ore, con 90 ore di tirocinio aziendale:

2. Recati al Centro Per l'Impiego (CPI) di competenza per richiedere l'adesione al Programma GOL.

3. Comunica all'operatore del CPI il nome ed il codice identificativo del corso scelto.

Se hai bisogno di assistenza o informazioni ci puoi anche contattarci ai seguenti recapiti:

Telefono: 08118181361

Cellulare: 327 087 0141

E-mail: segreteria@skillfactory.it

oppure puoi prenotare un appuntamento presso la nostra sede al Centro Direzionale di Napoli E2 scala A 1° piano.

Il "Tecnico Software"

![]() Gino Visciano |

Gino Visciano |

Skill Factory - 16/01/2025 17:42:56 | in Formazione e lavoro

Skill Factory - 16/01/2025 17:42:56 | in Formazione e lavoro

Il Tecnico Software è in grado di installare, configurare e personalizzare Sistemi Operativi e software applicativi secondo le esigenze dell'azienda in cui lavora o del cliente dove svolge consulenza.

Esegue interventi di manutenzione, aggiornamento del software, di backup e recupero dati, implementa procedure di virtualizzazione.

Esegue interventi di manutenzione, aggiornamento del software, di backup e recupero dati, implementa procedure di virtualizzazione.

Oltre ad essere un esperto di reti e di sicurezza dati, gestisce i servizi di cluod computing offerti dai principali provider (AWS, Azure, Google Cloud).

Analizzare le necessità di un'azienda o del cliente e le traduce nelle soluzioni IT appropriate. Monitora le prestazioni, la disponibilità e la sicurezza dell'infrastruttura IT, intervenendo in caso di problemi. Implementa e gestisce le misure di sicurezza per proteggere i dati e le applicazioni software, in conformità con le normative e le best practice.

Conosce gli strumenti di automazione in ambiente DevOps (ad esempio, GitHub, Terraform, Ansible, Kubernetes). In particolare il Tecnico Software interviene nel processo di Continuous Delivery, per automatizzare il processo di rilascio del software in ambienti di test e, idealmente, anche in produzione. L'obiettivo è rendere il rilascio del software un processo rapido, frequente e affidabile.

Per lavorare all'interno di team DevOps, oltre agli strumenti è deve conoscere anche le principali tecniche di project management agile, come le metodologie Kanban e Scrum.

Inoltre, è importante la conoscenza di Jira o strumenti equavalenti, perché offrono le funzionalità specifiche per supportare le metodologie Agili, come ad esempio la creazione di sprint, la gestione del backlog, la visualizzazione di to do list per monitorare lo stato di avanzamento del lavoro e gestire le attività.

Il Tecnico Software, può avere i seguenti sbocchi professionali: System Administrator, System Itegrator, Network Administrator, Security Administrator, Cloud Administrator, Rlease Manager.

Le aziende che possono essere interessate ad assumere o a richiedere servizi di consulenza al Tecnico Software sono le seguenti:

- Aziende di sviluppo software;

- Aziende che necessitano di infrastrutture IT scalabili e affidabili;

- Aziende che forniscono servizi attraveso infrastrutture di rete complesse;

- Aziende di marketing e vendita;

- Scuole ed Enti di formazione;

- Aziende del settore finanziario e bancario;

- Agenzie Interinali;

- Pubblica amministrazione.

Vuoi diventare Tecnico Software?

A febbraio, presso l'Academy Skill Factory, inizia il corso PAR GOL, per "Tecnico Software".

I corsi di formazione professionale PAR GOL sono finanziati dalla Regione Campania e ti permettono di acquisire una Qualifica Professionale Europea (EQF) e di partecipare ad un tirocinio formativo aziendale.

Invia il tuo CV o una manifestazione d'interesse a: recruiting@skillfactory.it

oppure

chiama ai seguenti numeri di telefono:

Tel.: 081/18181361

Cell.: 327 0870141

oppure

Contattaci attraverso il nostro sito: www.skillfactory.it

PAR GOL - Tecnico Software, con qualifica professionale EQF4 per diventare: Sistemista, Esperto di reti, Performance Tester

![]() Gino Visciano |

Gino Visciano |

Skill Factory - 09/05/2024 08:07:39 | in Formazione e lavoro

Skill Factory - 09/05/2024 08:07:39 | in Formazione e lavoro

Presso la nostra Academy puoi partecipare grauitamente al corso di Tecnico Software, grazie al progetto PAR GOL, finanziato dalla Regione Campania.

Presso la nostra Academy puoi partecipare grauitamente al corso di Tecnico Software, grazie al progetto PAR GOL, finanziato dalla Regione Campania.

Il percorso di formazione è rivolto a tutti i giovani disoccupati che vogliono acquisire le competenze che servono nel mondo del lavaoro; alla fine è previsto il rilascio della Qualifica Professionale Europea EQF4.

Il corso ha una durata di 300 ore e verrà svolto in presenza persso la nostra sede di Napoli - Centro Direzionale di Napoli isola E2.

Alla fine del percorso è previsto un tirocinio formativo presso le nostre aziende partner.

I partecipanti riceveranno un'indennità di €300,00 come rimborso spese, se avranno raggiunto l'80% delle presenze.

Il tecnico software è in grado di installare, configurare e personalizzare Sistemi Operativi, Reti e Software Applicativi secondo le esigenze del cliente. Esegue interventi di manutenzione, aggiornamento del software, di backup e recupero dati, implementa procedure di virtualizzazione ed esegue Performance Test per verificare la qualità dei sistemi.

Non perdere questa opportuntià per acquisire le competenze che ti servono per entrare nel mondo del lavaoro, contattaci subito, il corso è a numero chiuso, appena raggiungiamo il numero d'iscrizioni richiesto, chiudiamo la selezione.

Come puoi contattarci velocemente:

Se ti sei registrato su Skillbook clicca qui e invia una richiesta d'informazioni, verrai contattato al più presto possibile.

Per registrati su Skillbook, clicca qui.

Altrimenti, se non ti sei registrato su Skillbook puoi contattarci collegandoti al nostro sito www.skillfactory.it.

In alternativa puoi inviare il tuo CV o una manifestazione d'interesse a: recruiting@skillfactory.it

oppure

chiamare ai seguenti numeri di telefono:

Tel.: 081/18181361

Cell.: 327 0870141

Per maggiori informazioni sul progetto PAR GOL, clicca qui.

Per maggiori informazioni sulle Qualifiche Professionali Europee (EQF), clicca qui.

PAR GOL: Qualifiche Professionali Europee e Alfabetizzazione Informatica per tutti i giovani che non studiano e non lavorano. La Regione Campania finanzia la formazione.

![]() Gino Visciano |

Gino Visciano |

Skill Factory - 25/04/2024 10:54:53 | in Formazione e lavoro

Skill Factory - 25/04/2024 10:54:53 | in Formazione e lavoro

Il programma PAR GOL(Garanzia di Occupabilità dei Lavoratori) è attuato dalle Regioni e Province autonome sulla base dei Piani di attuazione regionali (PAR) approvati da Anpal.

E' un'azione di riforma prevista dal PNRR (Piano Nazionale di Ripresa e Resilienza) e ha l'obiettivo di riqualificare i servizi di politica attiva del lavoro.

Mira a ridisegnare i servizi per il lavoro per favorire la formazione e l'inserimento lavorativo delle persone. Entro il 2025 coinvolgerà 3 milioni di disoccupati e inoccupati, una grande opportunità anche per i giovani che non studiano e non lavoro, che rientrano nella categoria NEET (Not in Education, Employment, or Training). I giovani NEET In Italia sono circa 2 milioni.

Mira a ridisegnare i servizi per il lavoro per favorire la formazione e l'inserimento lavorativo delle persone. Entro il 2025 coinvolgerà 3 milioni di disoccupati e inoccupati, una grande opportunità anche per i giovani che non studiano e non lavoro, che rientrano nella categoria NEET (Not in Education, Employment, or Training). I giovani NEET In Italia sono circa 2 milioni.

Il programma GOL offre la possibilità di accedere a diversi corsi di formazione gratuiti, specificamente progettati per potenziare le competenze dei lavoratori, agevolarne la riqualificazione e favorire lo sviluppo del potenziale per l’inserimento o il reinserimento nel mercato del lavoro.

Questi corsi coprono una vasta gamma di settori e competenze, consentendo ai partecipanti di acquisire la abilità richieste dalle aziende.

Oltre alla formazione gratuita, è prevista anche una indennità di partecipazione e il rilascio di una Qualifica Professionale Europea (EQF).

Per approfondire l'argomento della Qualifica Professionale Europea (EQF), clicca qui.

Attraverso PAR GOL puoi anche migliorare sia le competenze digitali, sia le competenze trasversali indispensabili per qualunque ruolo professionale.

Il corso di formazione breve di "Key Competence" viene erogato in DAD (Didattica a Distanza) e prevede il rilascio della Qualifica Professionale Europea di tipo EQF2, hanno una durata di 60 ore e permettono di acquisire i contenuti seguenti:

1.Fondamenti di informatica generale;

1.Fondamenti di informatica generale;

2.Reti ed Internet;

3.Sistema operativo Windows/MS DOS;

4.Microsoft Word, Excel, PowerPoint e Outlook;

5.Organizzazione e principali processi aziendali;

6.Principi di project management;

7.Il lavoro di gruppo;

8.La gestione del tempo e delle priorità;

9.Come si crea un curriculum vitae.

Per partecipare al corso di formazione breve di "Key Competence", presso la nostra Academy "Skill Factory", rivolgiti al tuo centro per l'impiego (CPI), fornisci prima il codice identificativo della Skill Factory: 960 e successivamente quello del corso: 10777.

Presso la nostra Academy delle Professioni Digitali, con il programma PAR GOL, puoi anche partecipare ai seguenti corsi di formazione, che ti permettono di entrare nel mercato del lavoro:

1.TECNICO DELLA PROGRAMMAZIONE E DELLO SVILUPPO DI PROGRAMMI INFORMATICI

Codice corso: 10774

Modalità didattica: in presenza presso Academy Skill Factory Centro Direzionale Napoli isola E2

Durata: 300 ore

Tirocinio: 80 ore

Livello Qualifica Professionale Europea: EQF5

Prerequisiti di accesso: Diploma

Sbocchi lavorativi: Programmatore back-end (Java, C#, Python)

2.TECNICO PROGRAMMATORE SITI WEB

Codice corso: 10776

Modalità didattica: in presenza presso Academy Skill Factory Centro Direzionale Napoli isola E2

Durata: 300 ore

Tirocinio: 80 ore

Livello Qualifica Professionale Europea: EQF5

Prerequisiti di accesso: Diploma

Sbocchi lavorativi: Programmatore front-end (HTML/CSS, PHP, Angular, React)

3.TECNICO SOFTWARE

Codice corso: 10635

Modalità didattica: in presenza presso Academy Skill Factory Centro Direzionale Napoli isola E2

Durata: 300 ore

Tirocinio: 80 ore

Livello Qualifica Professionale Europea: EQF4

Prerequisiti di accesso: Diploma

Sbocchi lavorativi: Sistemista, Esperto di Cloud Computing e reti, Tester

4.TECNICO DELLA PROGETTAZIONE, IMPLEMENTAZIONE E MANUTENZIONE DI SISTEMI DI GESTIONE DI DATABASE

Codice corso: 10775

Modalità didattica: in presenza presso Academy Skill Factory Centro Direzionale Napoli isola E2

Durata: 300 ore

Tirocinio: 80 ore

Livello Qualifica Professionale Europea: EQF5

Prerequisiti di accesso: Diploma

Sbocchi lavorativi: SQL/NOSQL Database Administrator, Database Developer (Oracle, MS-SQL Server, MySQL, PostgreSQL, MongoDB)

5.TECNICO ESPERTO DI SICUREZZA INFORMATICA

Codice corso: 10639

Modalità didattica: in presenza presso Academy Skill Factory Centro Direzionale Napoli isola E2

Durata: 300 ore

Tirocinio: 80 ore

Livello Qualifica Professionale Europea: EQF5

Prerequisiti di accesso: Diploma

Sbocchi lavorativi: Sistemista, Esperto di Reti aziendali, Esperto di Cyber Security

6.SEGRETARIO-COORDINATORE AMMINISTRATIVO

Codice corso: 10778

Modalità didattica: in presenza presso Academy Skill Factory Centro Direzionale Napoli isola E2

Durata: 300 ore

Tirocinio: 80 ore

Livello Qualifica Professionale Europea: EQF5

Prerequisiti di accesso: Diploma

Sbocchi lavorativi: Responsabile Amministrazione/Segretaria aziendale, Gestione Risorse Umane, Esperto di Office Automation

7.OPERATORE DELLA INSTALLAZIONE E DELLA MANUTENZIONE DI IMPIANTI SPECIALI PER LA SICUREZZA

Codice corso: 10773

Modalità didattica: DAD (Didattica a distanza) e Tirocinio in presenza

Durata: 300 ore

Tirocinio: 80 ore

Livello Qualifica Professionale Europea: EQF3

Prerequisiti di accesso: Licenza media oppure Diploma

Sbocchi lavorativi: Tecnico di reti e d'impianti di videosorveglianza

2. Se sei un giovane con età inferiore ai 30 anni iscriviti al portale Garanzia Giovani.

3. Recati al Centro Per l'Impiego (CPI) di preferenza per richiedere l'adesione al Programma GOL.

4. Comunica all'operatore del CPI il nome ed il codice identificativo del corso scelto dal catalogo formativo Skill Factory e il codice dell'agenzia:960.

Se hai bisogno di assistenza o informazioni ci puoi anche contattarci ai seguenti recapiti:

Telefono: 08118181361

Cellulare: 327 087 0141

E-mail: segreteria@skillfactory.it

oppure puoi prenotare un appuntamento presso la nostra sede al Centro Direzionale di Napoli E2 scala A 1° piano.

Sei uno studente oppure un lavoratore? Scopri qual è il tuo livello di EQF.

![]() Gino Visciano |

Gino Visciano |

Skill Factory - 06/03/2024 23:15:13 | in Formazione e lavoro

Skill Factory - 06/03/2024 23:15:13 | in Formazione e lavoro

La formazione può essere formale, non formale e informale.

La formazione può essere formale, non formale e informale.

L'apprendimento formale segue regole e piani predefiniti, come avviene a scuola o attraverso i percorsi di formazione professionale, questo tipo di formazione è riconosciuto e può essere verificato e certificato.

L'apprendimento non formale è quello che avviene attraverso le esperienze formative personali o aziendali, fatte per approfondire le conoscenze e le abilità in uno specifico ambito di competenze e che servono per favorire la propria crescita professionale. Questo tipo di formazione è molto importante, ma può essere certificata da attestati oppure qualifiche non riconosciti dal sistema di formazione formale.

L'apprendimento informale avviene attraverso le esperienze risultanti dalle attività della vita quotidiana legate al lavoro, alla famiglia, al tempo libero. Questo tipo di formazione, pur essendo fondamentale per la vita di ogni cittadino, non può essere certificato, ma deve essere dimostrato attraverso la capacità di sapere e saper fare.

In Europa, prima del 2008, ogni nazione utilizzava un proprio sistema di formazione e qualifica. Con l'obiettivo di favorire la mobilità dei cittadini, le pari opportunità e un adeguato livello di formazione permanente, nel 2008 è stato creato l'EQF.

L'EQF (European Qualifications Framework) è il quadro europeo delle qualificazioni, nasce allo scopo di comparare il livello d'istruzione e il livello di qualifica professionale degli studenti e dei lavoratori di tutta l'Europa.

Il Centro europeo per lo sviluppo della formazione professionale (Cedefop) e la Fondazione europea per la formazione (ETF), in quanto agenzie europee, svolgono un ruolo importante nel sostenere l'attuazione dell'EQF.

In Italia l'EQF è conosciuto come quadro nazionale delle qualificazioni (QNQ), rappresenta il dispositivo nazionale che favorisce le attività per rendere comparabili i livelli di studio e le qualifiche professionali degli studenti e dei lavoratori italiani, con quelli delle altre nazioni europee.

In linea con il quadro europeo delle qualifiche (EQF) , il QNQ si sviluppa su tre dimensioni:

1) conoscenze

2) abilita'

3) autonomia e responsabilita'.

Attraverso queste tre dimensioni si può descrivere il tipo di competenza che bisogna avere per raggiungere uno degli 8 livelli di qualificazione EQF, dove il livello 1 è il più basso e l'8 è il più alto.

Il QNQ è stato istituito nel 2013 dal MINISTERO DEL LAVORO E DELLE POLITICHE SOCIALI di concerto con il MINISTERO DELL'ISTRUZIONE, DELL'UNIVERSITA' E DELLA RICERCA.

Il Quadro nazionale delle qualificazioni è lo strumento che descrive e classifica le qualifiche rilasciate nell'ambito del Sistema nazionale di certificazione delle competenze.

Per leggere gli articoli del decreto pubblicati sulla "Gazzetta Ufficiale", clicca qui.

Per avere una mappa dettagliata del lavoro e delle qualificazioni, del nostro Sistema nazionale di certificazione delle competenze, puoi consultare l'ATLANTE DEL LAVORO E DELLE QUALIFICAZIONI.

L'Atlante nasce dal lavoro di ricerca condotto dall'INAPP (Istituto Nazionale Per l'Analisi delle Politiche Pubbliche), con la partecipazione di diversi soggetti istituzionali, delle parti datoriali e sindacali, delle rappresentanze bilaterali, delle associazioni professionali, degli esperti settoriali e degli stakeholder del sistema lavoro-learning.

Per accedere all'ATLANTE DEL LAVORO E DELLE QUALIFICAZIONI, clicca qui.

La tabella seguente mostra la corrispondenze tra i livelli EQF e i titoli di studio che si possono coseguire in Italia:

Livello EQF | Tipologia di qualificazione

1 Diploma di licenza conclusiva del I ciclo di istruzione

2 Certificazione delle competenze di base acquisite in esito all'assolvimento dell'obbligo di istruzione

3 Attestato di qualifica di operatore professionale

4 Diploma professionale di tecnico, Diploma liceale, Diploma di istruzione tecnica, Diploma di istruzione professionale, Certificato di specializzazione tecnica superiore

5 Diploma di tecnico superiore

6 Laurea, Diploma Accademico di I livello

7 Laurea Magistrale, Diploma Accademico di II livello, Master universitario di I livello, Diploma Accademico di specializzazione (I), Diploma di perfezionamento o master (I)

8 Dottorato di ricerca, Diploma accademico di formazione alla ricerca, Diploma di specializzazione, Master universitario di II livello, Diploma Accademico di specializzazione (II), Diploma di perfezionamento o master (II)

Utilizzando la tabella seguente, puoi individuare il livello EQF che corrisponde al tuo profilo professionale in base al livello di conoscenza, abilità, autonomia e responsabilità raggiunto:

Per informazioni e contatti: www.skillfactory.it

Le Tue Aule

Le Tue Aule

I Tuoi Gruppi

I Tuoi Gruppi

Le Tue Selezioni

Le Tue Selezioni

Scheda Azienda

Scheda Azienda